そら2があなたのプロンプトをブロックする理由(本当の理由)

2025年初頭から, AIビデオ制作 を超えるまでに成長した。 全世界で3億2,000万人の消費者ユーザー, そしてOpenAIは、安全性とコンプライアンスをSora 2のデザインの骨格に据えた。つまり、Sora 1や他のモデルでは動作していたいくつかのプロンプトが即座にブロックされるということだ。.

要するにだ: そら2は3重の安全チェックを行うため、あなたのプロンプトはブロックされます。-IPの悪用、露骨な素材、プライバシー侵害などのリスクを検出するために、世代を重ねる前、世代を重ねる間、世代を重ねた後。もし コンテンツ制限をバイパスする, ここにガイドがある。.

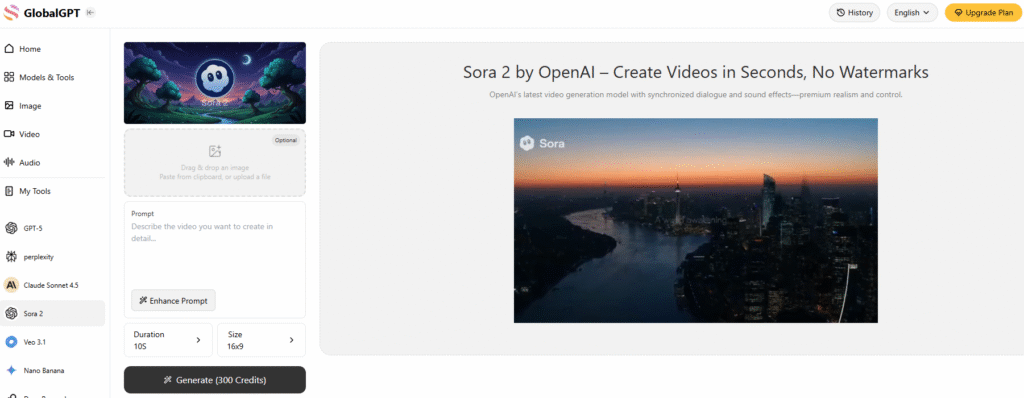

そら2のコンテンツ制限を回避する最も効果的な方法のひとつは、次のようなものだ。 Sora 2を統合したAll-in-One AIプラットフォームを使用する。 - この方法なら、コンテンツの制限をはるかに少なくすることができる。 ウォーターマークの煩わしさがない. .さらに良いことに、これらのサードパーティのSora 2プラットフォームは、以下のようなことがない。 面倒な招待コードが必要 どちらかだ。.

グローバルも Veo3.1を統合, 最もパワフルな2つのビデオジェネレーションモデルにアクセスできる。 その他ビデオモデル10本以上 グローバルGPTで同時に.

3層のモデレーション・アーキテクチャー

Sora 2のモデレーションは、クリエイティビティを守るファイアウォールのように構築されている。OpenAIはこれを「予防第一」モデルと呼んでいる。つまり、システムは違反の可能性があるものを後で修正するのではなく、早い段階でフィルタリングするということだ。各レイヤーの仕組みは以下の通り:

1.プロンプト・レベルのスキャン

生成が始まる前に、Sora 2はあなたのテキスト入力を分析し、センシティブな用語やポリシー違反の用語を調べます。これには、アダルトや暴力的な内容といった明白なケースだけでなく、“有名人の肖像”、“政治的なシナリオ”、“リアルな軍事暴力 ”といった微妙なリスクも含まれます。”

例えば、私が以前、『SF』からインスパイアされた短編映画風のクリップを作ろうとしたとき、『SF』からインスピレーションを得た。 歴史的な戦い, そら2』は、このプロンプトに「暴力的な描写がある」というレッテルを貼って却下した。その後、「戦闘描写」ではなく「英雄的なストーリーテリング」に重点を置くように調整し、ようやく合格となった。この経験は、そら2の言語フィルターがいかに特殊かを教えてくれた。.

2.メディアアップロードレビュー

参考画像やクリップをアップロードすると、Sora 2のシステムはOCR(光学式文字認識)を実行し、禁止されている素材や著作権で保護されている素材がないか視覚的にチェックします。ロゴ、有名人の顔、プライベートの詳細がないかどうかを調べます。.

一度、自撮り写真をアップロードして、そら2に “ビーチのシーンに衣装を変えて ”と頼んでテストしてみたことがある。驚くことに、“不適切なコンテンツ ”としてフラグが立った。この種の誤認識はOpenAIのコミュニティフォーラムで頻繁に話題になっており、ちょっとした編集(ズボンを短パンに変えるなど)でもブロックされたとの報告がユーザーから寄せられている。.

特に、2025年初頭に未成年のユーザーがNSFWコンテンツを要求するために医療用語を使ってフィルターを迂回したことが発覚した後ではなおさらだ。.

3.フレーム単位のポストジェネレーション・スキャニング

動画が生成されても、すぐに公開されるわけではありません。そら2のパフォーマンス フレームレベルのビデオモデレーション, ヘイトシンボル、露骨なイメージ、加工された肖像など、隠されたポリシー違反がないか各フレームを分析する。.

OpenAIによると、この最終的なスキャンは以下を除去する。 95-99% ユーザがダウンロードする前に、問題のある動画を削除するのだ。これは安全性の面では素晴らしいことだが、歴史再現やボディーアートのような合法的なクリエイティブ・コンテンツが集中砲火を浴びることを意味する。.

そら2が最も難しい節度あるケースに対処する方法

ブロックされたプロンプトがすべて同じとは限らない。そら2は 特殊ルールセット 過去に世論の反発を招いたリスクの高いカテゴリー、特に肖像権生成、知財保護、未成年の安全性など。.

1.肖像画とIP保護

2024年、ユーザーが実在の俳優やアニメキャラクターの似顔絵を無許可で作成するなど、度重なる物議を醸した後、OpenAIは以下のようなサービスを展開した。 “「オプトイン方式 どのような人物に対してもだ。.

今すぐだ、, 有名人や架空の人物を生成することはできない。 IP所有者が明示的に承認しない限り。例えば、“James Bond ”や “Mario ”を生成すると、即座にブロックされます。.

個人の肖像については、Sora 2は明確な同意を必要とします。自分の写真をアップロードしてモデルに使用を許可することはできますが、本人の承認なしに他人のビデオを作成することはできません。OpenAIはまた “私の似顔絵を探す&削除する” この機能は、自分の画像が含まれている動画を検索して削除できるもので、リミックス動画に自分の顔が無断で登場したときに自分で試したものだ。.

2.AI生成コンテンツの透明性

そら2が制作したすべてのビデオには、現在、次の2つが含まれている。 見える透かしと見えない透かし. .視聴者のために画面上にダイナミックな透かしが入り、さらにファイルに隠れたメタデータが埋め込まれる。.

これにより、プラットフォームやパブリッシャーは、OpenAIの公式検出ツールを使ってAI由来のコンテンツを検証することができる。.

3.未成年者の保護

Sora 2は、未成年者に対して妥協を許さない。安全でない文脈で子供を生成したり描写したりするために使用される可能性のあるあらゆるプロンプトをブロックします。システムのフィルターは、テキストレベルとビジュアルスキャンの両方で適用され、不適切なシナリオに未成年者が登場しないようにします。.

このアプローチは、以下のような世界的な法律と一致している。 COPPA 米国では、EUやアジアでも同等の枠組みがある。.

節度と創造性が出会うとき:真のユーザーとの闘い

こうしたシステムには明確な根拠があるにもかかわらず、モデレーションはクリエイターの不満に火をつけた。私を含め、多くのクリエイターが「そら2」に不満を持っている。 制限が多すぎる 合法的な創造的プロジェクトのために。.

OpenAIの開発者フォーラムでは、「髪型を変える」「服を入れ替える」といった無害な編集でフラグを立てられたという報告があり、あるクリエイターは、写真の背景を街の通りからビーチに移動させようとしてロックアウトされたと述べている。.

私も同じ問題に遭遇した。 教育的または芸術的コンテンツ-古典的な彫刻やダンスの動きの研究のように、誤って安全でないと判定される可能性がある。これは慎重すぎるように見えるかもしれないが、OpenAIは「潜在的な危害よりも偽陽性の方が望ましい」と述べている。“

OpenAIは、その功績を称え、次のような対応をした。 “「文脈理解」レイヤー, これは、芸術的表現と有害なコンテンツを区別しようとするものである。たとえば、教育目的で暴力的な歴史的事件を描写したプロンプトは、以前よりもモデレーションを通過する可能性が高くなった。.

著作権の取り締まりとMPAの関与

で 2025年10月, モーション・ピクチャー・アソシエーション(MPA)は、『そら2』を次のように非難した。“組織的著作権侵害,映画のシーンを模倣したユーザー作成のクリップを引き合いに出している。これを受けて、OpenAIはIPツールのアップデートを加速させ、著作権者が、「家族向け」の文脈ではキャラクターを許可するが、暴力的な文脈や風刺的な文脈では許可しないといった、微妙な使用ポリシーを定義できるようにした。.

私自身のテストによると、この変更により、以前は全面禁止を引き起こしていた、安全なパロディやファンの賛辞に対するブロックされたプロンプトが著しく減少した。OpenAIが保護とクリエイティブな自由のバランスを取り始めていることは歓迎すべき兆候だ。.

開発者APIにおけるモデレーション

を通してそら2を使用している場合 API, モデレーションはオプションではない。すべてのAPIコール、特に ビデオ作成-自動コンプライアンスチェックを実行します。最終出力は、動画がモデレーション審査を通過するまで取得できません。.

Sora 2の上にアプリを構築する開発者にとって、これは法的リスクが少なく、デフォルトでより安全なユーザーコンテンツを提供できることを意味するが、同時に納期が遅くなることも意味する。コンプライアンスとスピードのトレードオフなのだ。.

ソラ2』モデレーション・システムの今後の展開

について AIビデオ市場は2025年後半に$186億ドルに達する予測, そして『ソラ2』のモデレーション・システムは、すでに業界のベンチマークとして扱われている。.

OpenAIは、著作権所有者とのパートナーシップを拡大し、(特に日本とEUにおける)地域コンプライアンスを改善し、誤検出を減らすためにコンテキスト検出を改良する予定です。クリエイターにとって、これはより安全でありながら進化し続ける環境であることを意味する。.

最後に思うこと創造性と責任のバランス

そら2を毎日何ヶ月も使っているうちに、そのモデレーション・システムはクリエイティビティを制限するためにあるのではなく、将来のためにあるのだと気づいた。確かに、罪のないプロンプトがブロックされるとイライラすることもある。しかし、AIビデオツールが直面しうる悪用の規模を考えれば、そのトレードオフは理解できる。.

そら2は次のように語っている。 AIの創造性と安全性は共存できる-しかし、システムのロジックをどのように操るかは、私たちクリエイター次第なのだ。モデレーションの仕組みを理解し、言い回しや参考文献を調整することで、より表現力豊かで、コンプライアンスに則った、世界に通用する結果を導き出すことができる。.