Warum Sora 2 deine Prompts blockiert (Der wahre Grund)

Seit Anfang 2025, AI-Videoerstellung explodierte auf über 320 Millionen Verbraucher weltweit, und OpenAI hat Sicherheit und Compliance zum Rückgrat des Designs von Sora 2 gemacht. Das bedeutet, dass einige Eingabeaufforderungen, die in Sora 1 oder anderen Modellen funktionierten, jetzt sofort blockiert werden - nicht, weil Sie etwas falsch gemacht haben, sondern weil das neue System absichtlich konservativ ist, um Missbrauch zu verhindern.

Kurz gesagt: Ihre Eingabeaufforderungen werden blockiert, weil Sora 2 dreifache Sicherheitsüberprüfungen durchführt-vor, während und nach der Generierung-, um Risiken durch IP-Missbrauch, explizites Material oder Verletzungen der Privatsphäre zu erkennen. Wenn Sie Umgehung von Inhaltsbeschränkungen, finden Sie hier einen Leitfaden.

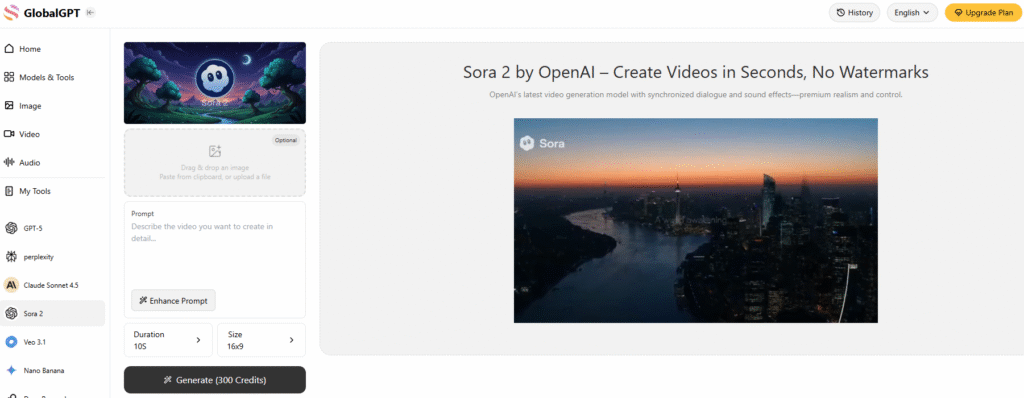

Eine der effektivsten Möglichkeiten, die Inhaltsbeschränkungen von Sora 2 zu umgehen, ist eine All-in-One-KI-Plattform verwenden, die Sora 2 integriert - Auf diese Weise werden Sie mit weit weniger inhaltlichen Einschränkungen und kein Ärger mit dem Wasserzeichen. Noch besser ist, dass diese Sora-2-Plattformen von Drittanbietern nicht diese lästigen Einladungscodes benötigen entweder.

Global jetzt auch Integriert Veo 3.1, und ermöglicht Ihnen den Zugriff auf die beiden leistungsstärksten Modelle für die Videogenerierung zusammen mit 10+ andere Videomodelle gleichzeitig auf Global GPT.

Die dreischichtige Moderationsarchitektur

Die Moderation von Sora 2 ist wie eine Firewall um die Kreativität herum aufgebaut. OpenAI nennt es ein ’Prevention-First“-Modell, was bedeutet, dass das System potenzielle Verstöße frühzeitig filtert, anstatt sie später zu beheben. Hier ist, wie jede Ebene funktioniert:

1. Scannen auf Aufforderungsebene

Noch bevor die Generierung beginnt, analysiert Sora 2 Ihre Texteingabe auf sensible oder gegen die Richtlinien verstoßende Begriffe. Dazu gehören offensichtliche Fälle - jugendgefährdende oder gewalttätige Inhalte -, aber auch subtile Risiken wie “Prominentenbilder”, “politische Szenarien” oder “realistische militärische Gewalt”.”

Als ich zum Beispiel einmal versucht habe, einen kurzen, filmähnlichen Clip zu erstellen, der von eine historische Schlacht, Sora 2 lehnte die Aufforderung mit der Begründung ab, sie sei “potenziell gewalttätig”. Nachdem ich die Aufforderung dahingehend geändert hatte, dass der Schwerpunkt auf “heldenhafte Erzählung” statt auf “Kampfdarstellung” lag, wurde sie schließlich akzeptiert. Diese Erfahrung hat mich gelehrt, wie spezifisch der Sprachfilter von Sora 2 ist - manchmal kann ein einziges Wort alles verändern.

2. Überprüfung des Medien-Uploads

Wenn Sie Referenzbilder oder -clips hochladen, führt das System von Sora 2 eine OCR (optische Zeichenerkennung) und visuelle Prüfungen auf verbotenes oder urheberrechtlich geschütztes Material durch. Es sucht nach Logos, Gesichtern von Prominenten oder privaten Details.

Ich habe dies einmal getestet, indem ich ein Selfie hochgeladen und Sora 2 gebeten habe, “das Outfit in eine Strandszene zu ändern”. Es wurde überraschenderweise als “unangemessener Inhalt” gekennzeichnet. Diese Art von Fehlalarmen ist ein häufiges Thema im OpenAI-Community-Forum, wo Benutzer berichten, dass selbst kleine Änderungen (wie das Ändern von Hosen in Shorts) blockiert werden.

Meiner Meinung nach geschieht dies, weil Sora 2 sehr vorsichtig ist - vor allem, nachdem minderjährige Nutzer dabei erwischt wurden, wie sie im Jahr 2025 die Filter umgingen, indem sie medizinische Terminologie verwendeten, um NSFW-Inhalte anzufordern.

3. Frame-by-Frame Post-Generation-Scanning

Sobald Ihr Video erstellt ist, wird es nicht sofort live geschaltet. Sora 2 führt aus Video-Moderation auf Bildebene, Dabei wird jedes Bild auf versteckte Richtlinienverstöße wie Hass-Symbole, explizite Bilder oder manipulierte Darstellungen untersucht.

Nach Angaben von OpenAI entfernt dieser letzte Scan 95-99% von problematischen Videos, bevor die Nutzer sie überhaupt herunterladen. Das ist zwar gut für die Sicherheit, bedeutet aber auch, dass einige legitime kreative Inhalte - wie historische Nachstellungen oder Körperkunst - ins Kreuzfeuer geraten.

Wie Sora 2 mit den schwierigsten Moderationsfällen umgeht

Nicht alle blockierten Prompts sind gleich. Sora 2 verwendet spezialisierte Regelwerke für Hochrisikokategorien, die in der Vergangenheit zu öffentlichen Reaktionen geführt haben - insbesondere Porträtierung, Schutz des geistigen Eigentums und Sicherheit von Minderjährigen.

1. Porträt und IP-Schutz

Nach wiederholten Kontroversen im Jahr 2024, bei denen Nutzer unerlaubte Ähnlichkeiten mit echten Schauspielern oder Anime-Charakteren erzeugten, hat OpenAI eine neue Software entwickelt. “Opt-in”-System für jede erkennbare Figur.

Jetzt, Sie können keinen Prominenten oder eine fiktive Figur erzeugen es sei denn, der Inhaber des geistigen Eigentums hat dies ausdrücklich genehmigt. Wenn Sie zum Beispiel “James Bond” oder “Mario” generieren, werden Sie sofort gesperrt.

Für Personenbilder verlangt Sora 2 die ausdrückliche Zustimmung. Sie können Ihr eigenes Foto hochladen und dem Modell erlauben, es zu verwenden, aber Sie können keine Videos von anderen ohne deren Zustimmung erstellen. OpenAI hat außerdem eine “Mein Bildnis finden und entfernen” Funktion, mit der Sie Videos suchen und löschen können, die Ihr Bild enthalten - etwas, das ich selbst getestet habe, als mein Gesicht ohne meine Zustimmung in einem Remix-Video erschien.

2. Transparenz für KI-generierte Inhalte

Jedes von Sora 2 produzierte Video trägt nun sowohl sichtbare und unsichtbare Wasserzeichen. Für die Betrachter gibt es ein dynamisches Wasserzeichen auf dem Bildschirm und in der Datei eingebettete Metadaten.

Dies ermöglicht es Plattformen und Publishern, KI-Inhalte mit den offiziellen Erkennungstools von OpenAI zu verifizieren. Dies ist wichtig, um Deepfakes und Fehlinformationen entgegenzuwirken, da KI-Videos immer realistischer werden.

3. Schutz von Minderjährigen

Sora 2 ist kompromisslos, wenn es um Minderjährige geht. Es blockiert jede Eingabeaufforderung, die dazu verwendet werden könnte, Kinder in unsicheren Kontexten zu erzeugen oder darzustellen. Die Filter des Systems werden sowohl auf Textebene als auch beim visuellen Scannen angewendet, um sicherzustellen, dass keine minderjährigen Personen in unangemessenen Szenarien erscheinen.

Dieser Ansatz steht im Einklang mit globalen Gesetzen wie COPPA in den USA und gleichwertige Rahmenwerke in der EU und Asien.

Wenn Mäßigung auf Kreativität trifft: Der wahre Kampf der Nutzer

Trotz des klaren Grundprinzips, das hinter diesen Systemen steht, hat die Moderation bei den Urhebern Frustration ausgelöst. Viele - mich eingeschlossen - fanden Sora 2 zu restriktiv für legitime kreative Projekte.

Im OpenAI-Entwicklerforum berichteten Nutzer, dass sie für harmlose Bearbeitungen wie das Ändern der Frisur“ oder das Tauschen von Outfits” markiert wurden, und ein Ersteller beschrieb, dass er ausgesperrt wurde, nachdem er versucht hatte, einen Fotohintergrund von einer Stadtstraße zu einem Strand zu verschieben.

Ich bin auf das gleiche Problem gestoßen: selbst pädagogische oder künstlerische Inhalte-wie klassische Skulpturen oder Tanzbewegungsstudien- fälschlicherweise als unsicher eingestuft werden. Auch wenn dies übervorsichtig erscheinen mag, hat OpenAI erklärt, dass “falsch positive Ergebnisse einem potenziellen Schaden vorzuziehen sind”.”

OpenAI hat darauf mit der Einführung einer “Ebene ”kontextuelles Verständnis", die versucht, zwischen künstlerischem Ausdruck und schädlichem Inhalt zu unterscheiden. So ist es beispielsweise wahrscheinlicher, dass eine Eingabeaufforderung, in der ein gewalttätiges historisches Ereignis zu Bildungszwecken beschrieben wird, die Moderation übersteht.

Die Durchsetzung des Urheberrechts und die Beteiligung der MPA

Unter Oktober 2025, warf die Motion Picture Association (MPA) Sora 2 vor, “Systematische Urheberrechtsverletzung,” und zitiert nutzergenerierte Clips, die Filmszenen nachahmen. Als Reaktion darauf beschleunigte OpenAI die Aktualisierungen seiner IP-Tools, die es den Urheberrechtsinhabern ermöglichen, nuancierte Nutzungsrichtlinien festzulegen - wie etwa die Zulassung ihrer Figuren in “familienfreundlichen” Kontexten, nicht aber in gewalttätigen oder satirischen Kontexten.

Nach meinen eigenen Tests hat diese Änderung die Zahl der blockierten Aufforderungen zu sicheren Parodien oder Fan-Huldigungen, die zuvor zu einem vollständigen Verbot führten, spürbar verringert. Es ist ein willkommenes Zeichen, dass OpenAI beginnt, Schutz und kreative Freiheit in Einklang zu bringen.

Moderation in Entwickler-APIs

Wenn Sie Sora 2 über das API, Die Moderation ist nicht optional. Jeder API-Aufruf - insbesondere erstellen_video-führt automatische Konformitätsprüfungen durch. Die endgültige Ausgabe kann erst abgerufen werden, wenn das Video die Moderationsprüfung bestanden hat.

Für Entwickler, die Anwendungen auf der Grundlage von Sora 2 entwickeln, bedeutet dies weniger rechtliche Risiken und standardmäßig sicherere Benutzerinhalte - aber auch langsamere Durchlaufzeiten. Es ist ein Kompromiss zwischen Compliance und Geschwindigkeit.

Wie geht es weiter mit dem Moderationssystem von Sora 2?

Die Der KI-Videomarkt wird bis Ende 2025 voraussichtlich $18,6 Milliarden erreichen, und das Moderationssystem von Sora 2 wird bereits als Maßstab für die Branche angesehen.

OpenAI plant den Ausbau von Partnerschaften mit Urheberrechtsinhabern, die Verbesserung der regionalen Compliance (insbesondere in Japan und der EU) und die Verfeinerung der kontextbezogenen Erkennung, um Falschmeldungen zu reduzieren. Für Urheber bedeutet dies eine sicherere, aber sich noch entwickelnde Umgebung - eine, in der wir unseren Prompt-Stil und unsere Formulierungen immer wieder anpassen müssen, um innerhalb der Grenzen zu bleiben.

Abschließende Überlegungen: Kreativität und Verantwortung im Gleichgewicht

Nachdem ich Sora 2 monatelang täglich benutzt habe, ist mir klar geworden, dass das Moderationssystem nicht dazu da ist, die Kreativität einzuschränken - es ist dazu da, sie zukunftssicher zu machen. Ja, es kann frustrierend sein, wenn unschuldige Eingabeaufforderungen blockiert werden. Aber in Anbetracht des Ausmaßes des Missbrauchs, dem KI-Videotools ausgesetzt sein könnten, ist der Kompromiss verständlich.

Sora 2 zeigt, dass KI-Kreativität und Sicherheit können nebeneinander bestehen-, aber es liegt an uns Schöpfern zu lernen, wie wir die Logik des Systems nutzen können. Wenn wir verstehen, wie die Moderation funktioniert, und unsere Formulierungen und Verweise anpassen, können wir aussagekräftigere, konforme und global akzeptable Ergebnisse erzielen.