لماذا يحجب Sora 2 موجهاتك (السبب الحقيقي)

منذ أوائل عام 2025, إنشاء فيديو بالذكاء الاصطناعي إلى أكثر من 320 مليون مستخدم مستهلك على مستوى العالم, وقد جعل OpenAI السلامة والامتثال العمود الفقري لتصميم Sora 2. هذا يعني أن بعض المطالبات التي كانت تعمل في Sora 1 أو النماذج الأخرى يتم حظرها الآن على الفور - ليس لأنك فعلت شيئًا خاطئًا، ولكن لأن النظام الجديد متحفظ عن قصد لمنع إساءة الاستخدام.

باختصار: يتم حظر مطالباتك لأن Sora 2 يقوم بتشغيل فحوصات أمان ثلاثية الطبقات-قبل التوليد وأثناءه وبعده- لاكتشاف المخاطر الناجمة عن إساءة استخدام بروتوكول الإنترنت أو المواد الفاضحة أو انتهاكات الخصوصية. إذا كنت تريد تجاوز قيود المحتوى, فإليك الدليل.

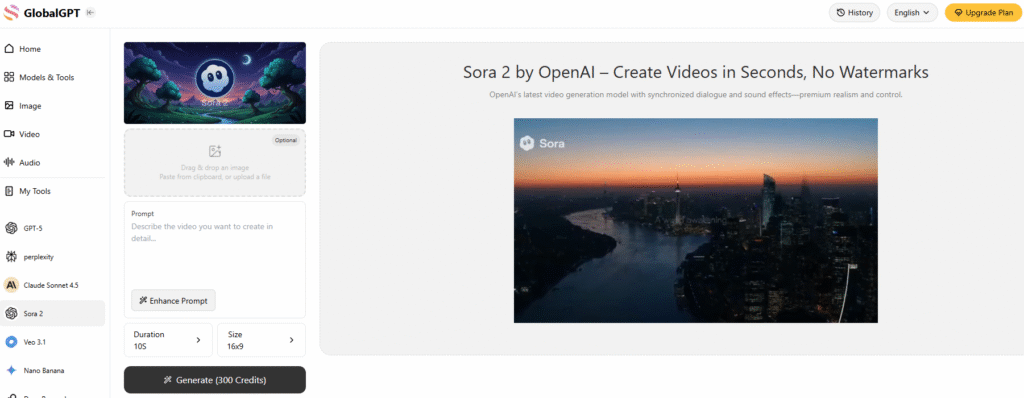

واحدة من أكثر الطرق فعالية لتجاوز قيود محتوى Sora 2 هي استخدام منصة الذكاء الاصطناعي المتكاملة التي تدمج سورا 2 - بهذه الطريقة، ستواجه قيودًا أقل بكثير على المحتوى و لا متاعب العلامات المائية. والأفضل من ذلك، فإن منصات Sora 2 التابعة لجهات خارجية لا تتطلب رموز الدعوة المزعجة إما.

العالمية الآن أيضًا يدمج فيو 3.1, مما يتيح لك الوصول إلى أقوى نموذجين لتوليد الفيديو إلى جانب أكثر من 10 نماذج فيديو أخرى في وقت واحد على Global GPT.

بنية الاعتدال ثلاثية الطبقات

تم بناء اعتدال Sora 2 مثل جدار حماية حول الإبداع. ويطلق عليه OpenAI نموذج ’الوقاية أولاً“، مما يعني أن النظام يقوم بتصفية الانتهاكات المحتملة في وقت مبكر بدلاً من إصلاحها لاحقاً. إليك كيفية عمل كل طبقة:

1. المسح على مستوى الموجه

قبل أن يبدأ التوليد، يقوم Sora 2 بتحليل مدخلاتك النصية بحثاً عن المصطلحات الحساسة أو المخالفة للسياسة. ويشمل ذلك الحالات الواضحة - المحتوى البالغ أو العنيف - ولكن أيضًا المخاطر الخفية مثل “التشبه بالمشاهير” أو “السيناريوهات السياسية” أو “العنف العسكري الواقعي”.”

على سبيل المثال، عندما حاولت ذات مرة إنشاء مقطع قصير على غرار الأفلام القصيرة مستوحى من معركة تاريخية, ،رفضت سورا 2 المطالبة، واصفة إياها بأنها “يحتمل أن تكون عنيفة”. بعد تعديله للتركيز على “السرد القصصي البطولي” بدلاً من “تصوير المعركة”، تم تمريره في النهاية. علّمتني هذه التجربة مدى دقة فلتر اللغة في Sora 2 - أحيانًا كلمة واحدة تغيّر كل شيء.

2. مراجعة تحميل الوسائط

إذا قمت بتحميل صور أو مقاطع مرجعية، يقوم نظام Sora 2 بتشغيل التعرف الضوئي على الحروف (OCR) والتحقق البصري من المواد المحظورة أو المحمية بحقوق الطبع والنشر. يبحث عن الشعارات أو وجوه المشاهير أو التفاصيل الخاصة.

لقد اختبرت ذلك مرة واحدة من خلال تحميل صورة شخصية وطلبت من Sora 2 “تغيير الزي إلى مشهد شاطئي”. تم الإبلاغ عنها بشكل مفاجئ على أنها “محتوى غير لائق”. كان هذا النوع من الإيجابيات الخاطئة موضوعًا متكررًا في منتدى مجتمع OpenAI، حيث أبلغ المستخدمون عن حظر حتى التعديلات البسيطة (مثل تغيير البنطال إلى سروال قصير).

من وجهة نظري، يحدث هذا لأن Sora 2 يخطئ بشدة في جانب الحذر - خاصةً بعد أن تم ضبط مستخدمين دون السن القانونية وهم يتجاوزون الفلاتر في وقت سابق من عام 2025 باستخدام مصطلحات طبية لطلب محتوى غير جنسي.

3. المسح الضوئي اللاحق للجيل التالي للإطار بإطار

بمجرد إنشاء الفيديو الخاص بك، لا يتم بثه على الفور. يؤدي سورا 2 اعتدال الفيديو على مستوى الإطار, وتحليل كل إطار بحثاً عن أي انتهاكات خفية للسياسة - أشياء مثل رموز الكراهية، أو الصور الصريحة، أو التشبيهات التي تم التلاعب بها.

وفقًا ل OpenAI، يزيل هذا الفحص النهائي 95-99% من مقاطع الفيديو الإشكالية قبل أن يقوم المستخدمون بتنزيلها. في حين أن هذا أمر رائع من أجل السلامة، إلا أنه يعني أيضاً أن بعض المحتوى الإبداعي المشروع - مثل إعادة تمثيل التاريخ أو فن الجسد - يقع في مرمى النيران.

كيف تتعامل سورا 2 مع أصعب حالات الاعتدال

ليست كل المطالبات المحظورة متساوية. يستخدم سورا 2 مجموعات القواعد المتخصصة للفئات ذات المخاطر العالية التي تسببت في رد فعل عام عنيف في الماضي - خاصةً توليد الصور، وحماية الملكية الفكرية، وسلامة القاصرين.

1. الصورة وحماية الملكية الفكرية

بعد جدالات متكررة في عام 2024 - مثل قيام المستخدمين بتوليد تشابهات غير مصرح بها لممثلين حقيقيين أو شخصيات أنيمي - طرحت OpenAI “نظام ”الاشتراك" لأي شخصية معروفة.

الآن, لا يمكنك توليد شخصية مشهورة أو خيالية ما لم يوافق مالك IP صراحةً على ذلك. على سبيل المثال، سيؤدي إنشاء “جيمس بوند” أو “ماريو” إلى حظر فوري.

بالنسبة للصور الشخصية المشابهة، يتطلب Sora 2 موافقة صريحة. يمكنك تحميل صورتك الخاصة والسماح للعارض باستخدامها، ولكن لا يمكنك إنشاء مقاطع فيديو للآخرين دون موافقتهم. أضاف OpenAI أيضًا “ابحث عن صورتي وأزلها” خاصية تتيح لك البحث عن مقاطع الفيديو التي تحتوي على صورتك وحذفها - وهو أمر اختبرته بنفسي عندما ظهر وجهي في مقطع فيديو معاد مزجه دون موافقتي.

2. الشفافية في المحتوى المولّد بالذكاء الاصطناعي

كل فيديو من إنتاج سورا 2 يحمل الآن كلاً من علامات مائية مرئية وغير مرئية. هناك علامة مائية ديناميكية على الشاشة للمشاهدين، بالإضافة إلى بيانات وصفية مخفية مضمنة في الملف.

وهذا يجعل من الممكن للمنصات والناشرين التحقق من المحتوى الصادر عن الذكاء الاصطناعي باستخدام أدوات الكشف الرسمية من OpenAI - وهو أمر بالغ الأهمية لمواجهة التزييف العميق والمعلومات المضللة مع زيادة واقعية مقاطع الفيديو التي تعتمد على الذكاء الاصطناعي.

3. حماية القصّر

سورا 2 غير متساهل عندما يتعلق الأمر بالقاصرين. فهو يحظر أي مطالبة يمكن استخدامها لتوليد أو تصوير الأطفال في سياقات غير آمنة. تنطبق فلاتر النظام على مستوى النص وعلى مستوى المسح المرئي، مما يضمن عدم ظهور أي أفراد دون السن القانونية في سيناريوهات غير مناسبة.

يتماشى هذا النهج مع القوانين العالمية مثل قانون حماية خصوصية الأطفال والمراهقين (COPPA) في الولايات المتحدة والأطر المماثلة في الاتحاد الأوروبي وآسيا.

عندما يلتقي الاعتدال مع الإبداع: صراع المستخدم الحقيقي

على الرغم من الأساس المنطقي الواضح وراء هذه الأنظمة، إلا أن الاعتدال أثار الإحباط بين المبدعين. الكثيرون - بمن فيهم أنا - وجدوا سورا 2 مقيدة للغاية للمشاريع الإبداعية المشروعة.

في منتدى مطوّري OpenAI، أبلغ المستخدمون عن تعرضهم للإبلاغ عن تعديلات غير ضارة مثل “تغيير تسريحة الشعر” أو “تبديل الملابس”، ووصف أحد المبدعين أنه تم حظره بعد محاولة نقل خلفية صورة من شارع المدينة إلى الشاطئ.

لقد واجهت نفس المشكلة: حتى أن محتوى تعليمي أو فني- مثل المنحوتات الكلاسيكية أو دراسات حركة الرقص - يمكن أن يتم وضع علامة غير صحيحة على أنها غير آمنة. على الرغم من أن هذا قد يبدو مفرطًا في الحذر، إلا أن OpenAI قد ذكر أن “الإيجابيات الخاطئة أفضل من الضرر المحتمل”.”

يُحسب للذكاء الاصطناعي المفتوح استجابته بتقديم “طبقة ”الفهم السياقي", التي تحاول التمييز بين التعبير الفني والمحتوى الضار. على سبيل المثال، من المرجح الآن أن تجتاز المطالبة التي تصف حدثًا تاريخيًا عنيفًا لأغراض تعليمية الاعتدال أكثر من ذي قبل.

الحملة على حقوق الطبع والنشر ومشاركة MPA

في أكتوبر 2025, اتهمت جمعية الأفلام السينمائية (MPA) سورا 2 بـ “الانتهاك المنهجي لحقوق الطبع والنشر,”، مستشهداً بمقاطع من إنشاء المستخدمين تحاكي مشاهد الأفلام. وردًا على ذلك، سرّعت OpenAI من تحديثات أدوات الملكية الفكرية الخاصة بها، مما سمح لأصحاب حقوق النشر بتحديد سياسات استخدام دقيقة - مثل السماح لشخصياتهم في سياقات “ملائمة للعائلة” ولكن ليس في سياقات عنيفة أو ساخرة.

من خلال اختباري الخاص، قلل هذا التغيير بشكل ملحوظ من المطالبات المحظورة للمحاكاة الساخرة الآمنة أو إشادة المعجبين، والتي كانت تؤدي في السابق إلى الحظر الكامل. إنها علامة مرحب بها على أن OpenAI بدأ يوازن بين الحماية والحرية الإبداعية.

الاعتدال في واجهات برمجة التطبيقات للمطورين

إذا كنت تستخدم Sora 2 من خلال واجهة برمجة التطبيقات, ، الاعتدال ليس اختياريًا. كل مكالمة من واجهة برمجة التطبيقات - خاصة إنشاء_فيديو-يدير عمليات التحقق من الامتثال التلقائي. لا يمكن استرداد الإخراج النهائي حتى يجتاز الفيديو مراجعة الإشراف.

بالنسبة للمطورين الذين ينشئون تطبيقاتهم على نظام Sora 2، فإن هذا يعني مخاطر قانونية أقل ومحتوى أكثر أماناً للمستخدمين بشكل افتراضي - ولكن أيضاً أوقات تسليم أبطأ. إنها مفاضلة بين الامتثال والسرعة.

ما التالي بالنسبة لنظام الاعتدال في سورا 2

إن من المتوقع أن يصل حجم سوق فيديو الذكاء الاصطناعي إلى $18.6 مليار دولار بحلول أواخر عام 2025, ، ونظام الاعتدال في Sora 2 يتم التعامل معه بالفعل كمعيار في هذا المجال.

يخطط OpenAI لتوسيع نطاق الشراكات مع مالكي حقوق الطبع والنشر، وتحسين الامتثال الإقليمي (خاصة في اليابان والاتحاد الأوروبي)، وتحسين الكشف السياقي للحد من الإشارات الخاطئة. بالنسبة للمبدعين، هذا يعني بيئة أكثر أمانًا ولكنها لا تزال تتطور - بيئة سنحتاج فيها إلى الاستمرار في تكييف أساليب وصياغة المطالبات للبقاء ضمن الخطوط.

أفكار أخيرة: الموازنة بين الإبداع والمسؤولية

بعد أشهر من استخدام Sora 2 يوميًا، أدركت أن نظام الاعتدال الخاص به ليس موجودًا للحد من الإبداع - إنه موجود لحماية المستقبل. نعم، يمكن أن يكون الأمر محبطاً عندما يتم حظر المطالبات البريئة. ولكن بالنظر إلى حجم سوء الاستخدام الذي يمكن أن تواجهه أدوات فيديو الذكاء الاصطناعي فإن المفاضلة مفهومة.

يُظهر سورا 2 أن يمكن أن يتعايش الإبداع والسلامة في الذكاء الاصطناعي-لكن الأمر متروك لنا نحن المبدعين لتعلم كيفية التعامل مع منطق النظام. من خلال فهم كيفية عمل الاعتدال وتعديل صياغتنا ومراجعنا، يمكننا فتح نتائج أكثر تعبيراً وتوافقاً ومقبولة عالمياً.